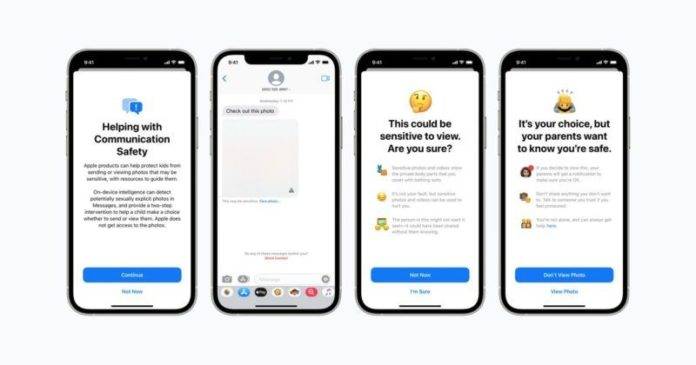

Apple জলদিই নতুন সফ্টওয়্যার আনতে চলেছে যা iCloud Photo কে এনালাইজ করবে আর যৌন শোষণ (Child Sexual Abuse) এর ফটোকে খুজবে। এই নতুন সফ্টওয়্যার এর ব্যবহার ইউজারদের iCloud এ সেভ ফটোর পরীক্ষা করে এটি নিশ্চিত করবে যে এতে শিশু যৌন শোষণের ফটো কিনা। যদি কোনো ইউজারের একাউন্টে এই রকমের কন্টেন্ট পাওয়া যায় তাহলে অ্যাপেল সেই ইউজার্স সম্পর্কে পুলিশকে জানাবে। অ্যাপেলের এই পদক্ষেপ যতোই প্রাইভেসিতে সরাসরি দখল করা হোক কিন্তু শিশু শোষণের যতো গম্ভীর অপরাধ কম করতে সাহায্যকর প্রমাণিত হতে পারে।

ব্লুমবার্গের রিপোর্ট অনুযায়ী Apple ম্যাসেজিং অ্যাপের মাধ্যমে পাঠানো আর রিসিভ হওয়া প্রত্যেক ফোটোকে এনালাইজ করবে যাতে এটা জানা যায় যে এটি শিশু যৌন শোষণের সাথে যুক্ত কিনা। যদি অ্যাপেল এরকম কোনো ফোটো পায় যেটি তারা খুজছে তাহলে তারা তৎখনাৎ অ্যাপেল সার্ভারে রিপোর্ট করবে। অ্যাপেলের এই ফিচার শুধুমাত্র ম্যাসেজিং পর্যন্ত সিমিত না। কোম্পানি শিশু যৌন শোষণের বিরুদ্ধে এই লড়াইয়ে নিজের ভয়েস এসিস্ট্যান্ট সিরিকেও কাজে লাগানোর প্রস্তুতি করছে। রিপোর্টে বলা হয়েছে যে যদি কোনো ইউজার শিশু যৌন শোষন সম্পর্কিত জিনিস সার্চ করে তাহলে সিরি মাঝে হস্তক্ষেপ করতে পারে।

অ্যাপেল কিভাবে করবে পরীক্ষা-নীরিক্ষা

যদি কোনো ইউজারের একাউন্টে অ্যাপেল শিশু যৌন শোষণ সম্পর্কিত জিনিস বেশি মাত্রায় দেখতে পায়, তাহলে কোম্পানি এই মামলাটিকে ম্যানুয়ালি দেখবে। এর সাথেই এর তথ্য ন্যাশনাল সেন্টার ফর মিসিং এন্ড এক্সপ্লয়টেড চিল্ড্রেনকে দেবে। শিশু যৌন শোষনের লড়াইয়ে অ্যাপেল যে টেকনিক ব্যবহার করছে সেটিকে NeuralHash বলা হয়, যা ইমেজকে হ্যাশে বা সংখ্যা ইউনিক সেটে কন্সার্ট করে।

প্রাইভেসি আর সিকিউরিটিতে বিপদ

জন্স হপকিন্স ইন্ফরমেশন সিকিউরিটি ইন্সটিটিউটের অ্যাসোসিয়েট প্রফেসর ম্যাথিউ গ্রিন অ্যাপেলের শিশু যৌন শোষণকে আটকানো আর জানার জন্য এই পদ্ধতি সম্পর্কে মত পেশ করেছে। তিনি বলেছিলেন যে অ্যাপেলের এই টুল যতোই iOS ইকোসিস্টেমে শিশু যৌন শোষন সম্পর্কিত কন্টেন্টের প্রসার যতোই কম করে দিক, কিন্তু এতে ইউজারের প্রাইভেসি আর সিকিউরিটি বিপদে চলে আসবে। Apple যতোই শিশু যৌন শোষন আর এর সম্পর্কিত কন্টেন্টের প্রসার আটকাতে চায়, কিন্তু এটি ইউজার্স আর তার ডিভাইসকে প্রায় সার্ভিলেন্সে রাখার মতো হবে, যার থেকে খুবই বিপদ হতে পারে।

শুধুমাত্র CSAM পরীক্ষার জন্য ব্যবহার হবে ফোটো

Apple এর দাবি যে তারা ইউজারের iCloud এ স্টোর করা ইমেজকে স্ক্যান করবে। অ্যাপেলের এই আইডিয়া থেকে বহু ইউজারের কাছে সহজ হবে না কারন আইক্লাউডে তাদের বেশিরভাগ প্রাইভেট ফাইল থাকে। তারা চাইবে না যা কোনো ফোন নির্মাতা কোম্পানি সেটি চেক করুক। কম করেও প্রাইভেসির মামলায় এটি কেউ মেনে নিতে পারবে না। অন্যদিকে Apple এর দাবি যে তারা কেবল CSAM ( Child Sexual Abuse Material) এর পরীক্ষার জন্য ফোটোর ব্যবহার করবে। অথচ এই টেকনিকের ব্যবহার CSAM ছাড়া কোনো গোয়ান্দাগিরি করার জন্য করা যেতে পারে। এর সাথেই অ্যাপেল সরকারের আগ্রহে ইউজারের যেকোনো ডেটার পরীক্ষা করতে পারে।

অথচ Apple একটি বয়ানে বলেছে যে এতে ইউজারের সেইসব ফোটোর সম্পর্কে যা তাদের মনে হয় যে শিশু যৌন শোষনের সম্পর্কে হতে পারে। অ্যাপেল নিজের বয়ানে এও বলেছিল যে ইউজার্স সরাসরি কোম্পানির সাথে যোগাযোগ করতে পারে যদি তাদের একাউন্ট ভুল পদ্ধতিতে ফ্ল্যাগ করা হয়। অ্যাপেলের এই সফ্টওয়্যার শিশু যৌন অপরাধ আটকানোর জন্য কতটা সাহায্যকর হবে তা আগামী সযয় বলবে কিন্তু আরো একবার ইউজারদের প্রাইভেসির কথা সামনে আসছে।

আমাদের ফেসবুকে ফলো করার জন্য এখানে ক্লিক করুন